28/11/2006

En la era digital, predecir el comportamiento del usuario es fundamental para el éxito de plataformas de recomendación, sistemas publicitarios y muchas otras aplicaciones. Saber si un usuario hará clic en un anuncio, comprará un producto o interactuará con un contenido específico puede marcar una diferencia abismal. Tradicionalmente, esto implicaba un arduo trabajo manual para identificar y codificar las interacciones relevantes entre las características (como la edad del usuario y la categoría del producto). Sin embargo, el volumen y la complejidad de los datos modernos han hecho que este enfoque sea cada vez más insostenible. Aquí es donde modelos avanzados como Deep Factorization Machine (DeepFM) entran en juego, ofreciendo una solución elegante y potente para este desafío.

¿Qué es DeepFM y Por Qué es Relevante?

DeepFM, o Máquina de Factorización Profunda, es un modelo de aprendizaje automático de vanguardia diseñado específicamente para abordar la complejidad de las interacciones entre características en grandes conjuntos de datos. Su principal fortaleza radica en su arquitectura híbrida, que integra dos enfoques poderosos: las Máquinas de Factorización (FM) y las Redes Neuronales Profundas (DNN).

La idea central detrás de DeepFM es capturar automáticamente tanto las interacciones de bajo orden como las de alto orden entre las características sin la necesidad de ingeniería de características manual y laboriosa. Mientras que las Máquinas de Factorización son excelentes para modelar interacciones explícitas de bajo orden (por ejemplo, la interacción entre un usuario y un artículo específico), las Redes Neuronales Profundas son capaces de aprender interacciones implícitas y altamente complejas de alto orden (patrones no lineales que involucran múltiples características simultáneamente).

Al combinar estos dos componentes, DeepFM logra una capacidad de modelado mucho más rica y completa. Esto lo hace particularmente efectivo en escenarios donde las interacciones entre características son clave para la predicción, pero son difíciles de identificar o formular manualmente. El resultado típico de un modelo DeepFM son números de punto flotante entre 0 y 1, que representan la probabilidad de un evento binario (como un clic o una compra), siendo extremadamente útiles para tareas de clasificación y ordenamiento.

Componentes Clave de DeepFM

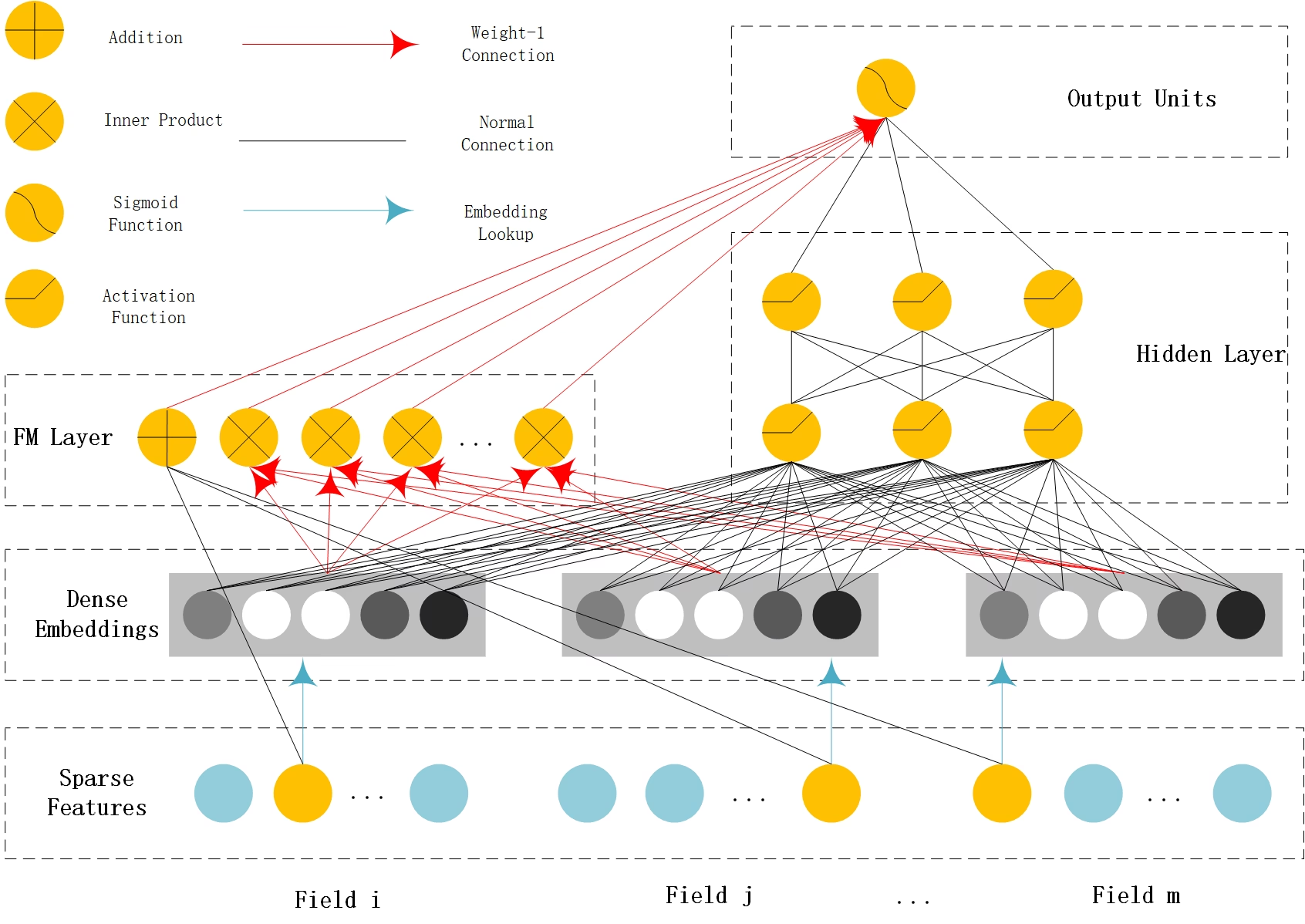

La arquitectura de DeepFM se compone principalmente de dos módulos que comparten la misma capa de entrada de características:

1. Componente FM (Factorization Machine):

Este módulo se encarga de modelar las interacciones de bajo orden entre pares de características. Aunque el texto proporcionado no describe en detalle cómo funciona una Máquina de Factorización por sí sola, sí indica que DeepFM utiliza este componente para capturar interacciones explícitas. Piensa en esto como aprender la importancia de combinar dos características específicas, como si un usuario (característica 1) interactúa con un tipo de producto (característica 2). Este componente es crucial para manejar características dispersas, como IDs de usuario o artículo, asignando vectores latentes (embeddings) a cada característica y modelando la interacción como el producto punto de sus vectores.

2. Componente Deep (Red Neuronal Profunda - DNN):

Este módulo es responsable de aprender las interacciones de alto orden. Aquí es donde entra en juego el poder del aprendizaje profundo. Tal como se describe para el aprendizaje profundo en general, este componente utiliza capas de nodos interconectados. La primera capa podría aprender a identificar patrones simples, las capas intermedias patrones más complejos, y las capas finales combinan estos patrones para hacer una predicción. En el contexto de DeepFM, la entrada a la DNN son los mismos embeddings densos de las características que se utilizan en el componente FM. La red profunda explora combinaciones no lineales y complejas de estas características, capturando interacciones implícitas que no son obvias a simple vista.

Ambos componentes (FM y Deep) se entrenan conjuntamente, compartiendo la capa de embedding inicial. Esto permite que el modelo aprenda representaciones de características que son óptimas tanto para capturar interacciones de bajo orden como de alto orden simultáneamente. La salida final de DeepFM es la suma de las salidas de los componentes FM y Deep, típicamente pasada a través de una función sigmoide para obtener una probabilidad entre 0 y 1.

Aplicaciones Prácticas de DeepFM

DeepFM brilla en escenarios donde la predicción precisa del comportamiento del usuario depende de la comprensión de cómo diversas características interactúan entre sí. Los casos de uso más comunes incluyen:

- Sistemas de Recomendación: Predecir si un usuario hará clic, calificará o comprará un artículo. DeepFM puede capturar interacciones complejas como 'usuarios jóvenes en zonas urbanas tienden a comprar ropa de una marca específica' o 'usuarios que vieron la película X y Y también disfrutan de la película Z'.

- Sistemas de Publicidad Online: Predecir la probabilidad de que un usuario haga clic en un anuncio (Click-Through Rate prediction - CTR). Esto es vital para optimizar la presentación de anuncios y maximizar los ingresos. DeepFM puede modelar cómo interactúan las características del usuario, del anuncio, del contexto (hora del día, dispositivo) y de la plataforma.

- Clasificación Binaria y Ranking: En cualquier tarea donde necesites clasificar elementos en dos categorías (sí/no, positivo/negativo) o rankear una lista de elementos según su relevancia o probabilidad de interacción.

El texto menciona específicamente el ejemplo de la predicción de clics en escenarios de recomendación de productos personalizados. Si el historial de comportamiento de un usuario es extenso pero no indica directamente su comportamiento futuro (es decir, los datos son dispersos y las relaciones no son lineales), DeepFM puede integrar eficazmente estos comportamientos. Al transformar características dispersas en representaciones densas de alta dimensión (los embeddings), el modelo puede aprender patrones significativos que métodos más simples pasarían por alto. La capacidad de DeepFM para manejar características categóricas (como género, categoría de producto) representadas como strings es particularmente útil en estos dominios.

El Poder del Aprendizaje Profundo en DeepFM

Comprender cómo funciona el componente profundo es clave para apreciar el poder de DeepFM. El aprendizaje profundo, como se explicó, utiliza redes neuronales artificiales. Estas redes están organizadas en capas, y cada capa aprende a identificar patrones de complejidad creciente. En una red de reconocimiento, las primeras capas pueden detectar bordes, las siguientes formas, y las últimas objetos completos. De manera similar, en DeepFM, las primeras capas de la DNN pueden aprender interacciones simples entre un par o tres características, mientras que las capas más profundas pueden aprender combinaciones mucho más abstractas y complejas que involucran muchas más características. Este proceso de aprendizaje se logra ajustando los 'pesos' de las conexiones entre los nodos de la red a través de técnicas de entrenamiento, permitiendo que la red 'clasifique' o 'prediga' mejor basándose en los datos.

La combinación de FM y DNN es lo que hace que DeepFM sea tan efectivo. No solo aprende las interacciones explícitas de pares, sino que también descubre patrones ocultos y complejos que influyen en el resultado final. Esta capacidad de aprendizaje automático de interacciones es su mayor ventaja, reduciendo drásticamente la necesidad de la costosa y a menudo ineficaz ingeniería de características manual, especialmente en dominios con características muy diversas y complejas.

DeepFM vs. Otros Modelos

Para entender mejor el valor de DeepFM, podemos compararlo con otros enfoques comunes:

| Característica | Modelos Lineales Simples | Máquinas de Factorización (FM) | Redes Neuronales Profundas (DNN) | DeepFM |

|---|---|---|---|---|

| Interacciones de Bajo Orden | Requiere ingeniería manual | Modela automáticamente (pares) | Puede aprender, pero no explícitamente para todos los pares | Modela automáticamente (pares) |

| Interacciones de Alto Orden | No modela | No modela | Modela automáticamente (complejas) | Modela automáticamente (complejas) |

| Ingeniería de Características Manual | Alta dependencia | Reducida para interacciones de pares | Reducida para interacciones complejas | Mínima/Nula |

| Manejo de Datos Dispersos | Ineficaz sin ingeniería | Efectivo con embeddings | Efectivo con embeddings | Altamente efectivo |

| Complejidad de Modelado | Baja | Moderada | Alta | Alta |

Como se observa en la tabla, DeepFM combina lo mejor de ambos mundos: la capacidad de FM para manejar la dispersión y aprender interacciones de bajo orden, y la capacidad de DNN para descubrir patrones complejos de alto orden. Esto lo posiciona como una solución muy robusta para problemas de predicción en entornos de datos complejos y dispersos.

Preguntas Frecuentes sobre DeepFM

Aquí respondemos algunas preguntas comunes sobre este modelo:

¿Qué problema principal resuelve DeepFM?

Resuelve el problema de capturar eficientemente interacciones entre características, tanto de bajo como de alto orden, sin requerir una extensa ingeniería de características manual. Esto es crucial en dominios donde las interacciones complejas impulsan el comportamiento del usuario pero son difíciles de identificar de antemano.

¿En qué escenarios se utiliza más DeepFM?

Se utiliza predominantemente en sistemas de recomendación y plataformas de publicidad online para tareas como la predicción de clics (CTR prediction), predicción de conversiones, y ranking de elementos. También es aplicable en cualquier tarea de clasificación binaria o ranking con datos tabulares donde las interacciones entre características son importantes.

¿Cómo maneja DeepFM las características categóricas?

Las características categóricas (como IDs de usuario, IDs de artículo, categorías) se convierten típicamente en vectores densos de baja dimensión, conocidos como embeddings. Estos embeddings son aprendidos durante el entrenamiento del modelo y se utilizan como entrada tanto para el componente FM como para el componente Deep. Este enfoque es muy eficaz para representar características dispersas y permitir que el modelo aprenda relaciones entre ellas.

¿DeepFM requiere ingeniería de características?

Comparado con modelos tradicionales, DeepFM reduce drásticamente la necesidad de ingeniería manual de interacciones de características. Modela automáticamente tanto las interacciones de bajo orden como las de alto orden. Sin embargo, sigue siendo importante realizar un preprocesamiento básico de las características (como manejo de valores nulos, normalización si es necesario, y codificación de categóricas) antes de alimentar los datos al modelo.

¿Qué tipo de salida proporciona DeepFM?

La salida final de DeepFM es generalmente una probabilidad (un valor entre 0 y 1) que indica la probabilidad de que ocurra el evento objetivo (por ejemplo, la probabilidad de un clic). Esta salida probabilística es ideal para tareas de clasificación binaria y para ordenar elementos según su probabilidad predicha.

Conclusión

DeepFM representa un avance significativo en el campo de la modelización predictiva, particularmente en dominios como los sistemas de recomendación y la publicidad digital. Al combinar de manera inteligente la capacidad de las Máquinas de Factorización para capturar interacciones explícitas de bajo orden con el poder de las Redes Neuronales Profundas para descubrir patrones complejos de alto orden, ofrece una solución integral y eficiente. Su capacidad para aprender automáticamente estas interacciones reduce la carga de la ingeniería de características manual y mejora la precisión de las predicciones, lo que lleva a sistemas más efectivos y una mejor experiencia para el usuario. A medida que los conjuntos de datos continúan creciendo en tamaño y complejidad, modelos como DeepFM se vuelven cada vez más esenciales para extraer valor y comprender el comportamiento subyacente.

Si quieres conocer otros artículos parecidos a DeepFM: Más Allá de la Predicción Simple puedes visitar la categoría Radio.